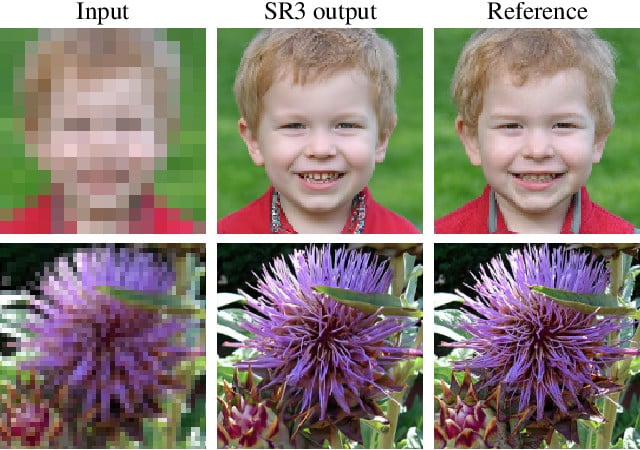

A técnica é chamada de imagem de “super-resolução”. Trata-se de obter uma imagem próxima da realidade a partir de uma imagem hiper pixelizada – normalmente, esse é um processo que pode ser visto em muitos filmes ou séries de detetive, quando os protagonistas dão zoom em uma foto. Para revelar, por exemplo, o placa de um carro ou o rosto de seu motorista, que básico, não estão resolvidos. As novas ferramentas de inteligência artificial desenvolvidas pelo Google são perfeitamente capazes de fazer isso.

Observe que a técnica é relativamente complexa; na verdade, trata-se aqui de adicionar a uma imagem detalhes que a câmera não captou quando a foto foi tirada. As ferramentas em questão aqui conseguem preencher essas lacunas de outras imagens relativamente semelhantes. Observe que o resultado não é uma cópia carbono da realidade, mas é próximo o suficiente para que o olho humano a veja como tal.

Para realizar essa façanha, o Google desenvolveu duas novas ferramentas: Super-Resolução via Refinamento Repetido (SR3) e Modelos de Difusão em Cascata (CDM). A dupla oferece resultados de tirar o fôlego: durante um teste de observação envolvendo cerca de cinquenta voluntários, as imagens geradas por essas novas ferramentas foram confundidas com fotos reais em aproximadamente 50% dos casos. ” Com o SR3 e o CDM, levamos o desempenho dos modelos de difusão ao estado da arte “, explica Jonathan Ho, pesquisador científico e Chitwan Saharia, engenheiro de software, do Brain Team of Google Research.

Uma IA baseada em modelos de difusão

A super-resolução – a transformação de uma imagem de baixa resolução em uma imagem detalhada de alta resolução – tem muitas aplicações, que podem variar desde a restauração de retratos de família antigos até o aprimoramento de sistemas de imagens médicas.

Os métodos tradicionais de síntese natural de imagens, especialmente imagens criadas por redes antagonistas generativas (GANs), apresentam algumas fragilidades quando se trata de treinar um modelo para sintetizar amostras de alta qualidade a partir de dados complexos e em alta resolução. É por isso que os especialistas do Google Research recorreram aos chamados modelos de difusão, que apresentam melhor estabilidade durante a fase de aprendizagem e permitem gerar amostras de qualidade de imagens (e áudio).

Os modelos de difusão funcionam corrompendo os dados de treinamento: eles adicionam ruído gaussiano gradualmente e, em seguida, apagam lentamente os detalhes dos dados até que se tornem ruído puro; finalmente, eles formam uma rede neural para reverter esse processo de corrupção. A execução desse processo de corrupção reversa sintetiza os dados do ruído puro, eliminando o ruído gradualmente até que uma amostra “limpa” seja produzida.

É assim que funciona o algoritmo SR3 desenvolvido pelo Google : ele adiciona ruído ou imprevisibilidade a uma imagem e, em seguida, reverte o processo – da mesma forma que um editor de imagens tentaria refinar suas fotos de férias. Assim, a partir de uma série de cálculos baseados em um grande banco de dados de imagens, SR3 é capaz de imaginar como seria uma versão em alta resolução de uma foto de baixa qualidade. O software oferece resultados impressionantes de super-resolução para fotos de rosto e imagens naturais ao redimensionar para resoluções 4 a 8 vezes maiores que as da imagem de baixa resolução de entrada.

Modelos “em cascata” para melhorar a qualidade da ampliação

Os pesquisadores ainda apontam que esses modelos de super-resolução podem ser usados em cascata para aumentar o fator de escala de super-resolução efetivo – que envolve, por exemplo, empilhar um modelo de super-resolução de 64 × de uma face. 64 a 256 × 256 e 256 × 256 a 1024 × 1024, a fim de realizar uma tarefa de super-resolução de 64 × 64 a 1024 × 1024.

Os modelos de difusão em cascata (CDM) podem, portanto, ser vistos como “pipeline” por meio do qual os modelos de difusão – incluindo SR3 – podem ser redirecionados para atualizações de resolução de imagem de alta qualidade. Ele usa modelos de aprimoramento como entrada e gera imagens muito maiores, com muito mais eficiência do que os métodos de ampliação atuais. Além de incluir o modelo SR3 no pipeline, os pesquisadores também introduziram uma nova técnica de aumento de dados, chamada “aumento de condicionamento”, que melhora ainda mais os resultados de qualidade da amostra do MDL.

Esse novo mecanismo de IA foi testado notavelmente no ImageNet, um enorme banco de dados de imagens de treinamento comumente usado para pesquisa de reconhecimento visual de objetos. As imagens de rostos humanos geradas pelo SR3 foram confundidas com fotos reais aproximadamente 50% do tempo; um resultado realmente impressionante, saber que um algoritmo é considerado perfeito quando atinge um índice de confusão de 50%, segundo os pesquisadores.

O Google planeja ir ainda mais longe com seus novos mecanismos de inteligência artificial e tecnologias relacionadas, não apenas na escala de imagens de rostos e outros objetos naturais, mas também em outras áreas de modelagem de probabilidade. ” Estamos entusiasmados para testar ainda mais os limites dos modelos de difusão para uma ampla variedade de problemas de modelagem generativa “, concluem os pesquisadores.

Fonte: Trust my Science